Deepfakes im Unterricht: Erkennen und verstehen

Dieser Artikel wurde zuletzt am 25. Februar 2026 aktualisiert.

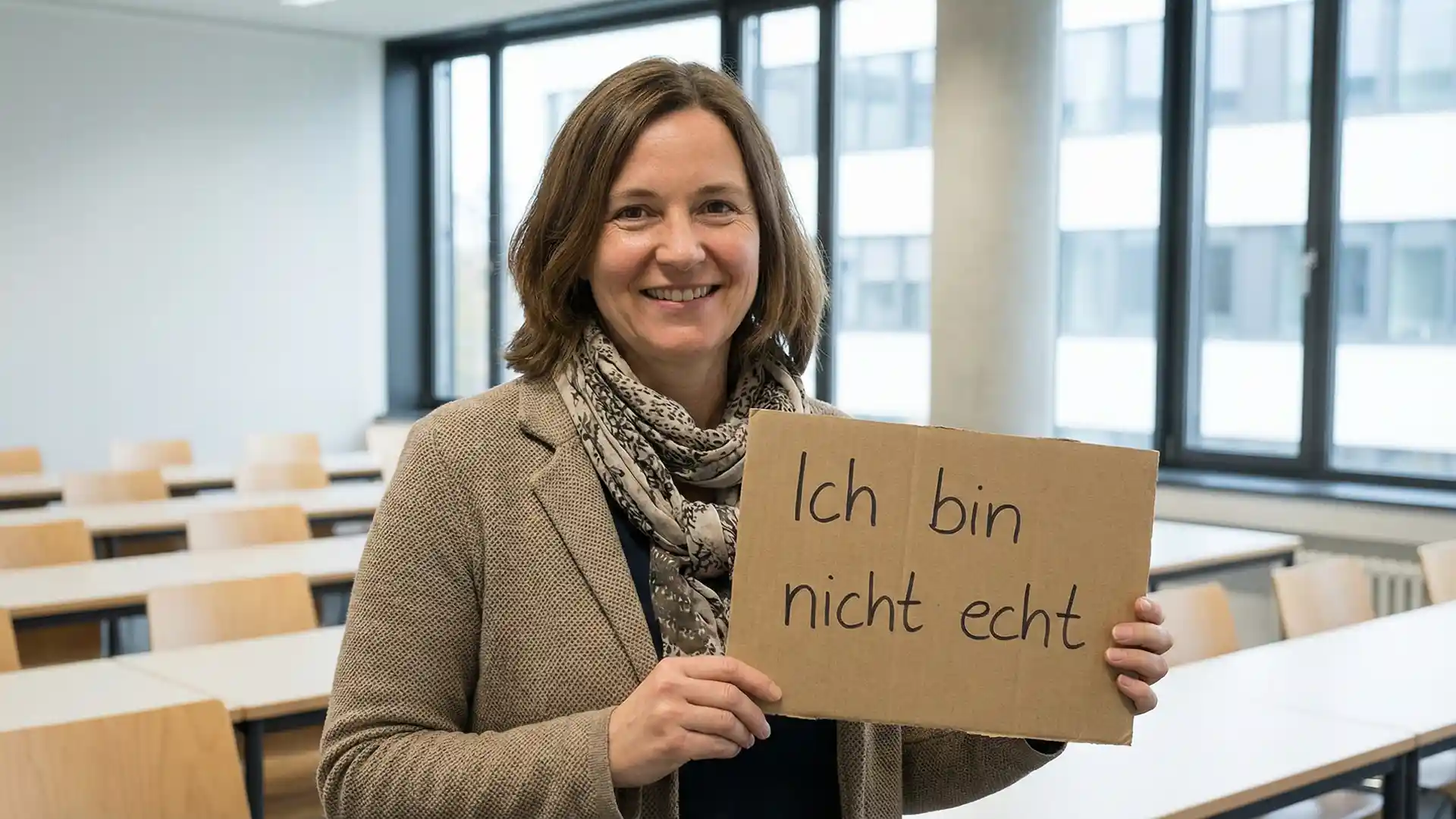

Stell dir vor, du öffnest morgens TikTok oder Instagram und siehst ein Video, in dem Bundeskanzler Friedrich Merz eine völlig überraschende Aussage trifft. Nur: Das Video ist komplett künstlich. Stimme, Gesichtsausdruck, sogar die Lichtreflexe in den Augen stammen von einer KI. Und während du noch überlegst, ob das echt sein kann, haben tausende andere den Clip schon gesehen und geteilt. Ich zeige dir, wie du solche Deepfakes im Unterricht behandeln kannst und dadurch deine Medienbildung verbesserst.

Inhaltsverzeichnis

Warum Deepfakes den Unterricht verändern

Deepfakes und KI-generierte Videos gehören inzwischen zum digitalen Alltag, auch von Schülerinnen und Schülern – vielleicht sogar noch stärker als in anderen Gruppen, da sie in den sozialen Medien sehr aktiv sind. So begegnen ihnen zwischen Memes, Musikclips und Nachrichten auch vermehrt KI-Videos mit teils kriminellen Absichten. Die technische Qualität ist mittlerweile so hoch, dass selbst geübte Augen getäuscht werden können.

Für den Unterricht bedeutet das: Medienkompetenz ist keine Zusatzaufgabe mehr, sondern eine Grundvoraussetzung. Es geht nicht nur darum, Deepfakes zu erkennen, sondern auch zu verstehen, wie leicht Bilder, Stimmen und ganze Videos heute verändert werden können. Die Schule ist daher ein wichtiger Ort, um Deepfakes und KI-Videos zu erklären und einzuordnen.

💡 Tipp: In unserem Online-Kurs „Medienkompetenz – KI-Videos“ lernst du Schritt für Schritt, wie KI-Videos funktionieren, wo die Gefahren lauern und wie du das im Unterricht vermitteln kannst. Dieser Beitrag basiert auf einzelnen Kapiteln.

KI verstehen und nicht grundsätzlich negativ sehen

Wenn man über Deepfakes spricht, klingt das oft bedrohlich: Manipulation, Fake News, Betrug. Doch künstliche Intelligenz ist nicht grundsätzlich etwas Negatives. Im Gegenteil, sie eröffnet völlig neue kreative Möglichkeiten. Gerade als Filmemacher nutze ich viele dieser Möglichkeiten: Zum Erstellen von Drehbüchern, zur Visualisierung von Ideen bis hin zum Reduzieren von generischen Aufgaben beim Videoschnitt.

An dieser Stelle daher eine Begriffsklärung: KI-Videos meint alle Videos, die mit Hilfe von künstlicher Intelligenz erstellt wurden, also auch kreative oder journalistische Werke. Deepfakes dagegen haben oft eine Täuschungsabsicht oder kriminelle Motive. In diesem Zusammenhang spricht man dann auch oft von Fake News.

Auch in der Filmproduktion an sich oder in den sozialen Medien entstehen durch KI spannende Formate. Komplexe Themen lassen sich plötzlich einfach visuell erklären, Geschichten humorvoll erzählen oder gesellschaftliche Phänomene in kurzer Form aufarbeiten. Für den Unterricht kann das sogar ein Gewinn sein: KI-Videos können helfen, komplizierte Sachverhalte darzustellen oder Diskussionen über Ethik, Technik und Wahrheit anzustoßen. Sehe KI-Videos als nicht als grundsätzlich schlecht, sondern stelle dich der „bedrohlichen“ Technologie. Sie ist immerhin gekommen, um zu bleiben. Wir können nur lernen, damit umzugehen.

Entscheidend ist nicht, ob ein Video KI-generiert ist, sondern wie es eingesetzt wird. Gefährlich wird es erst dann, wenn Inhalte gezielt Emotionen manipulieren oder Falschinformationen verbreiten. Die meisten Clips sind aber schlicht Unterhaltung, was sie dürfen und auch bleiben sollten.

Kritisches Denken als wichtigste Fähigkeit der Medienkompetenz

KI-Videos werden immer besser, aber das wichtigste Werkzeug zur Erkennung bleibt der menschliche Verstand. Kritisches Denken ist die Grundlage, um zwischen echten und manipulierten Inhalten zu unterscheiden. Es geht nicht darum, jedem Video zu misstrauen, sondern bewusst zu hinterfragen, ob das Gesehene plausibel ist. Der gesunde Menschenverstand ist die stärkste Waffe gegen Desinformation.

Viele Menschen glauben besonders leicht an Inhalte, die ihre Meinung bestätigen. Auf Social Media entstehen so Filterblasen: Man bekommt immer mehr von dem angezeigt, was zur eigenen Sichtweise passt. Mit der Zeit kann daraus ein Gefühl objektiver Wahrheit werden. Das Phänomen beobachten wir schon lange, aber KI-Videos machen es gefährlicher den je. Verstärkt wird dieser Effekt zudem durch die Algorithmen sozialer Plattformen, die Inhalte auf Datenbasis empfehlen. Dadurch lässt sich auch erklären, warum sich Fake News (also scheinbar echte aktuelle Nachrichten) so rasant verbreiten.

Ein bewährter Ansatz zum Erkennen von KI-Videos ist die sogenannte SIFT-Methode. Sie hilft, Inhalte strukturiert zu prüfen:

- Stop: Glaube nicht alles sofort.

- Investigate: Hinterfrage die Quelle.

- Find better coverage: Suche nach weiteren Berichten.

- Trace to the original: Finde den ursprünglichen Ursprung (z. B. das ganze Video).

🎓 Unterrichtsidee für Deepfakes: Teile die Klasse in kleine Gruppen. Jede Gruppe bekommt ein anderes Video (echt oder KI-generiert) und soll es mit der SIFT-Methode analysieren. Anschließend präsentieren sie, wie sie zu ihrem Ergebnis gekommen sind. Das fördert nicht nur kritisches Denken, sondern auch Teamarbeit und Medienreflexion. Im Online-Kurs findest du eine solche Aufgabe mit passenden Videoclips.

Dieses Video habe ich für den Online-Kurs innerhalb von wenigen Minuten erstellt. Als Basis diente eine echte Aufnahme der Tagesschau auf YouTube. Mit einem kurzen KI-Clip eines Löwen und einem KI-Sprecher habe ich den Inhalt glaubwürdig verändert. Durch die einfache und schnelle Art der Manipulation kann so auch auf laufende Situationen schnell in Form eines Deepfakes reagiert werden. Andere seriöse Quellen gibt es zu diesem Zeitpunkt ggf. wenige und eine inhaltliche Prüfung fällt schwer.

Sichere dir kostenlos die Checkliste

Melde dich kostenlos zu unserem Newsletter an und lade dir die Checkliste zum Erkennen von KI-Videos und Deepfakes aus unserem Online-Kurs herunter.

Quellen prüfen und Fakten checken

Ein virales Video allein beweist noch nichts. Erst wenn man weiß, wer es veröffentlicht hat, warum und ob andere Quellen darüber berichten, lässt sich seine Glaubwürdigkeit einschätzen. Diese Fähigkeit ist heute eine Schlüsselkompetenz und gerade für junge Menschen, die täglich von visuellen Inhalten überflutet werden, enorm wichtig.

Stelle dir also die folgenden Fragen:

- Wer hat das Video veröffentlicht?

- Welche Absicht steckt dahinter?

- Wird das gleiche Ereignis auch in anderen Medien erwähnt?

- Wie emotional ist die Sprache oder Bildgestaltung?

Eine einfache Websuche kann oft schon Klarheit schaffen. Wenn ein großes Ereignis nur auf TikTok oder Instagram auftaucht, aber nicht in etablierten Nachrichtenquellen wie der Tagesschau, BBC oder den großen Nachrichtenmagazinen, kannst du von einer Fälschung ausgehen.

Auch technische Hilfsmittel sind nützlich:

- Mit der Google Bildrückwärtssuche oder TinEye kannst du das ursprüngliche Material finden und z. B. mit dem Datum abgleichen.

- Deepware Scanner oder Hive AI Detector sind spezialisierte Tools, die Hinweise auf KI-Generierung liefern. Diese sind aber meist kostenpflichtig und nur in besonderen Fällen wirklich sinnvoll.

ℹ️ Diese Methoden helfen nur, wenn ein Anfangsverdacht besteht. Gerade in den sozialen Medien überprüfen wir nicht jeden Beitrag. Dadurch entsteht zwangsläufig eine Meinungsbildung. Meiner Ansicht nach wird es daher unvermeidlich sein, eine Kennzeichnungspflicht einzuführen. Alternativ könnten die Plattformen stärker in die Verantwortung genommen werden. Beide Ansätze werden derzeit sowohl auf nationaler als auch auf EU-Ebene diskutiert, zum Beispiel im Rahmen des AI Act.

🎓 Unterrichtsidee: Lass in einer Gruppenarbeit ein virales Video (z. B. ein Nachrichtebeiztrag) analysieren, das zweifelhaft wirkt. Die Schülerinnen und Schüler sollen das Video hinterfragen und prüfen. Anschließend wird das Ergebnis präsentiert.

Deepfakes durch technische Merkmale erkennen

Wenn Deepfakes im Unterricht thematisiert werden, spielt das Erkennen und Einordnen von KI-Videos eine zentrale Rolle. Auch wenn solche Videos immer besser werden, werden sie häufig kleine Unstimmigkeiten verraten. Das wichtigste Merkmal: KI-Bilder oder Videos sind in der Regel zu perfekt. Glatte Haut ohne Struktur und wie aus einem Fotoshooting, Kleidung wie aus dem Produktkatalog und Haltung bzw. Ausdruck wie in Stock-Material. Das hat natürlich den Grund, dass die KI-Modelle genau mit diesem Material trainiert wurden. Die Modelle werden aber immer besser und „weniger perfekt“. Aber es gilt damit auch: Die Trainingsdaten waren vorhanden und sind echt. Gerade Produktfotos oder auch Stock-Material hat trotz der echten Aufnahme diesen perfekten Look. Ein allgemeingültiges Indiz ist das daher nicht.

Achte bei Videos vor allem auf das Folgende, da hier oftmals Unstimmigkeiten auftreten. Grundsätzlich sind viele Punkte auch auf ein statisches Bild anzuwenden.

- Mundbewegungen: Stimmen und Lippen passen nicht exakt zusammen, oder Zähne wirken unnatürlich.

- Augen Augen blinzeln zu selten oder asynchron.

- Bewegungen: Übergänge wirken „morphend“, Bewegungen passen nicht zur Sprache.

- Objekte: Verschwimmen oder verändern Form und Größe.

- Hauttöne: Zu glatte Haut, unnatürliche Übergänge zwischen Gesicht und Hintergrund.

- Licht und Schatten: Unglaubwürdige, oft sehr weiche Beleuchtung, Schatten passen nicht zur Lichtrichtung.

- Reflektionen: Oft unnatürlich und nicht realistisch

- Stimme: Unnatürliche Betonungen und Pausen oder eine Studio ähnliche Akustik ohne Störgeräusche

Vor einiger Zeit galt noch, dass KI vor allem Texte oder kleine Grafiken nicht gut darstellen konnte. Das ist mittlerweile überholt und Texte können sauber erstellt werden. Dennoch entstehen oft unlogische Wörter oder Kombinationen.

Diese Hinweise erkennt man am besten auf einem größeren Bildschirm und weniger gut auf dem kleinen Display eines Smartphones.

ℹ️ Tipp: Pausiere ein Video in einer Bewegung. Hier verschwimmen oft Details, manchmal verschwinden auch ganze Objekte – das fällt mit der Bewegungsunschärfe im Video oft nicht auf.

Beispiel für den Unterricht: Wie KIs Markenprodukte erzeugen

Um Deepfakes im Unterricht greifbar zu machen, kannst du Beispiele nutzen, die für die meisten sofort verständlich sind. Die Darstellung von Markenprodukten oder Logos z. B. sind für KIs kein Problem (mehr), vor allem, wenn es sich um bekannte und große Marken handelt. Das folgende Video ist nur durch die Eingabe eines Prompts entstanden. Dazu habe ich zuerst für jede Szene ein Bild erstellen lassen und dann daraus einen kurzen Videoclip. Ich habe keine Referenzbilder für z. B. die Logos hochgeladen, sondern nur die jeweiligen Kleidungsstücke benannt. Es ist erstaunlich, wie konsistent die Darstellung auch in komplexen Bewegungen bleibt. Das Fehlen bekannter Produkte ist also kein Hinweis auf KI.

An dieser Stelle stellt sich auch die Frage, welche Folgen das für die jeweiligen Unternehmen hat. So kann jede (reale) Person plötzlich die Kleidung jedes Unternehmens tragen. Das ist sicherlich nicht immer gewünscht und kann auch rechtliche Folgen haben. Grundsätzlich gilt, dass ein Design oder Logo in der Regel geschützt ist und nicht einfach nachgebaut werden darf. Mit der Erstellung einer täuschend echt aussehenden Nachbildung kann das daher eine Marken- oder Designrechtsverletzung darstellen.

Vor allem bei der Verwendung von Logos reagieren viele Unternehmen verständlicherweise auch juristisch, vor allem bei kommerziellen Absichten oder mit einer Täuschungsabsicht. Dennoch ist es nur mit der Eingabe der Marke oder des Produkts problemlos möglich, entsprechende Ergebnisse zu bekommen. Die KIs wurden schließlich mit zahlreichen Produktbildern trainiert.

Ein aktuelles anderes Beispiel zu dieser Thematik betrifft OpenAIs Sora 2 (eine sehr fortschrittliche Video-KI). Das Unternehmen hinter ChatGPT kämpft in den USA mit Widerstand der Unterhaltungsbranche. Grund ist, dass die KI täuschend echte Nachbildungen von Personen und Produkten ermöglicht.

OpenAI spielte im Anschluss das juristische Unschuldslamm, da es in seiner ursprünglichen Nutzungsrichtlinie ein sogenanntes Opt-out-Modell verankerte. Dieses erlaubte die Veröffentlichung urheberrechtlich geschützten Materials, solange die Rechteinhaber nicht explizit widersprachen. Nach OpenAIs Vorstellungen musste man der Firma also explizit melden, dass man nicht in Sora2 „vorkommen“ will.

Slashcam.de

ℹ️ KI kann unsere „echte Welt“ detailgetreu nachbilden, von Personen bis hin zu bekannten Markenprodukten. Genau das macht ihre Ergebnisse so überzeugend: Sie wirken oft genauso, wie wir es aus der Realität kennen. Das ermöglicht neue kreative Projekte, aber auch Deepfakes mit Täuschungsabsicht. Entscheidend ist daher, wie wir als Gesellschaft mit dieser Technologie umgehen.

Deepfakes im Unterricht: Chancen, Risiken und Lernziele

Deepfakes sind faszinierend und beunruhigend zugleich. Sie zeigen, wie weit die digitale Bild- und Videotechnik inzwischen ist und wie leicht sich die Wirklichkeit inszenieren lässt. Doch anstatt Angst zu machen, können Deepfakes im Unterricht zum Ausgangspunkt einer spannenden Medienbildung werden. Zeige dazu am besten Beispiele, welche die Jugendlichen aus dem Alltag kenne und vermeide zu abstrakte Themen.

Denn am Ende ist nicht die Technik entscheidend, sondern der Umgang damit. Wer lernt, kritisch zu denken, Quellen zu prüfen und Inhalte bewusst zu hinterfragen, wird auch in einer Welt voller KI-Videos nicht so leicht getäuscht. Übrigens sind KI-Inhalte oft in der Form gefährlich, dass sie ein grundsätzliches Misstrauen an etablierte Medien erzeugen. So können auch echte Videos als KI erscheinen und eine „Täuschung“ findet nur durch einen falschen Kontext statt. Auch das solltest du im Unterricht thematisieren, denn viele Schülerinnen und Schüler können zwar KI-Videos erkennen, sie aber nicht richtig einordnen oder verstehen, warum solche Inhalte überhaupt erstellt werden. Häufig wird das Thema deshalb vorschnell mit „Das erkennt doch jeder!“ abgetan. Medienbildung geht also deutlich über reine IT-Kenntnisse hinaus.

💡 Wenn du tiefer einsteigen möchtest: Im Movie Mentor Online-Kurs „Medienkompetenz KI-Videos“ findest du tiefergehende Informationen und Unterrichtsmaterial für Deepfakes, mit denen du Medienkompetenz im Klassenzimmer gezielt fördern kannst. Auf unserer Übersichtsseite für KI-Videos findest du zudem viele weitere Themen rund um KI und die Videoproduktion an Schulen.

Wie siehst du KI? Ist es eher eine Gefahr oder Chance?

FAQs für Lehrkräfte zu KI-Videos

Was ist der Unterschied zwischen einem KI-Video und einem Deepfake?

KI-Videos sind grundsätzlich erstmal alle Videoclips, die mit einer künstlichen Intelligenz erstellt wurden. Das können auch künstlerische oder journalistische Videos sein. Ein Deepfake hingegen hat eine Täuschungsabsicht, indem z. B. reale Gesichter oder Stimmen täuschend echt nachgebildet werden.

Wie unterscheiden sich Deepfakes von klassischen Filmtechniken wie Greenscreen oder CGI?

Greenscreen und CGI werden bewusst als kreative oder technische Gestaltungsmittel eingesetzt, um Szenen zu erweitern oder visuelle Effekte zu erzeugen. Deepfakes hingegen sollen meist täuschend echt wirken und werden häufig eingesetzt, um Zuschauer über die Echtheit des Materials zu täuschen.

Was ist Voice Cloning und ist das legal?

Voice Cloning bezeichnet das Erstellen einer KI-Stimme basierend auf einer echten Stimme. Somit kannst du nach dem Upload einer kurzen Stimmprobe geschriebene Texte mit der jeweilige Stimme sprechen lassen. In Deutschland darfst du nur deine eigene Stimme klonen, oder du brauchst eine ausdrückliche Zustimmung der betreffenden Person.

Was versteht man unter Face-Swap?

Beim Face-Swap („Gesichtstausch“) wird das Gesicht einer Person digital durch das einer anderen ersetzt. Das kann auf Fotos oder in Videos geschehen.

Gibt es eine gesetzliche Kennzeichnungspflicht für KI-Videos?

In der EU ist eine Kennzeichnung von KI-generierten Inhalten künftig verpflichtend (durch den AI Act). Plattformen wie TikTok oder YouTube kennzeichnen solche Inhalte bereits automatisch – teils über Metadaten oder Upload-Einstellungen. Trotzdem ist Transparenz noch nicht überall konsequent umgesetzt.

Sind alle KI-Videos automatisch Deepfakes?

Nein. KI-Videos sind nicht grundsätzlich problematisch. Viele werden kreativ oder journalistisch genutzt, etwa zur Animation, Erklärung komplexer Themen oder für Bildungsinhalte. Deepfakes dagegen verfolgen meist eine Täuschungsabsicht, z. B. bei politischer Propaganda oder Cybermobbing.

Können KIs reale Personen oder Produkte erstellen?

Ja, viele KI-Tools können reale Personen oder auch Produkte (wie Kleidungsstücke inkl. Logo) erstellen und nachbilden. Das geschieht entweder nur per Texteingabe oder durch das Hochladen eines Referenzbildes. Grundsätzlich ist das aber rechtlich problematisch, da Persönlichkeitsrechte oder Design- und Markenschutzrechte verletzt werden können. Einige Plattformen erkennen solche Fälle automatisch und blockieren entsprechende Prompts oder erzeugen nur ähnliche, aber nicht identische Ergebnisse.

Muss ich Deepfakes im Unterricht behandeln?

Ja. Deepfakes sollten im Unterricht (spätestens ab Sekundarstufe I) behandelt werden, weil sie im Lehrplan vieler Bundesländer als Teil der Medienkompetenz und digitalen Bildung verankert sind. Schülerinnen und Schüler sollen lernen, manipulierte Inhalte zu erkennen und kritisch zu hinterfragen, was eine zentrale Fähigkeit im Umgang mit digitalen Medien darstellt.

Tag:KI